Agentic AI w 2026: firmy przyspieszają, ale zaufanie i governance nie nadążają

Jeśli 2025 był rokiem „sprawdźmy, czy to działa”, to 2026 jest rokiem „wdrażamy, bo inaczej zostajemy w tyle”. Tak to opisuje Informatica, podsumowując badanie 600 liderów danych.

Najważniejsze w 60 sekund

- GenAI jest już w 69% organizacji, a kolejne 25% planuje wdrożenie w 12 miesięcy.

- Agentic AI, jako systemy, które nie tylko generują, ale też „działają”, ma już 47% firm, a kolejne 31% planuje w rok.

- Skala rośnie, ale zaufanie bywa ślepe: 65% organizacji deklaruje wysoki poziom zaufania pracowników do danych używanych przez AI, a jednocześnie 75% liderów mówi o brakach w data literacy i 74% w AI literacy.

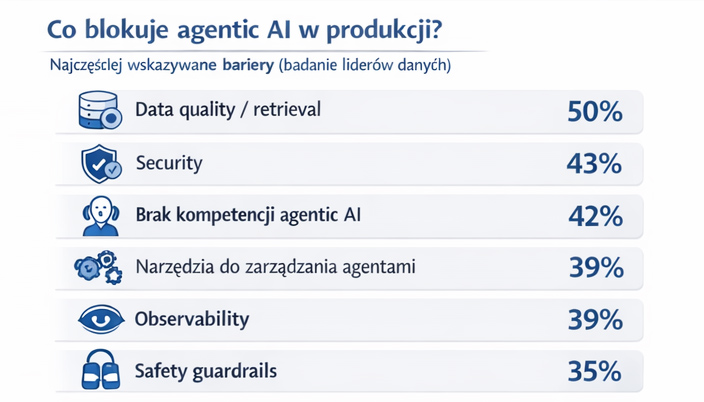

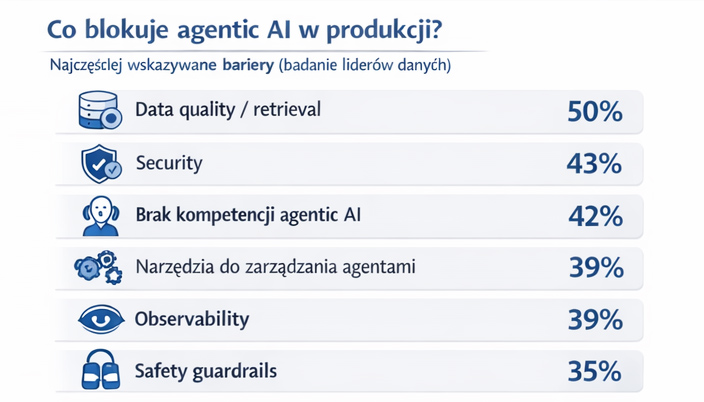

- Najczęstsze blokery produkcji agentów: jakość danych i retrieval (50%), security (43%), brak kompetencji (42%), narzędzia do zarządzania agentami (39%), observability (39%), guardrails (35%).

Co to jest agentic AI

W skrócie: agentic AI to podejście, w którym system AI nie kończy pracy na wygenerowaniu odpowiedzi, tylko podejmuje działania: wywołuje narzędzia, wykonuje kroki w procesie, eskaluje do człowieka, zapisuje w systemie. To naturalny „następny krok” po GenAI — i dlatego firmy tak mocno przyspieszają.

„Trust paradox”: ludzie ufają, choć nie potrafią tego zweryfikować

Jedna z najbardziej praktycznych obserwacji z badania to tzw. trust paradox: pracownicy ufają danym i wynikom AI, ale często nie mają kompetencji, żeby ocenić, kiedy AI ma rację, a kiedy brzmi przekonująco i… myli się. W raporcie: 65% deklaracji zaufania vs. potrzeba doszkolenia (75% data literacy, 74% AI literacy).

To jest realne ryzyko w środowisku produkcyjnym – szczególnie tam, gdzie decyzje dotykają: cen, ofert, ryzyka kredytowego, reklamacji, PII, zgodności.

Wniosek praktyczny: jeśli budujesz agentów, równolegle budujesz nawyki weryfikacji (proces) i kompetencje (ludzie). Inaczej agent będzie „jechał na autorytecie”.

6 barier, które najczęściej blokują agentów w produkcji — i jak je odblokować

Poniżej lista barier wprost z raportu (z procentami) oraz „co zrobić jutro rano”, żeby nie utknąć na POC.

1) Jakość danych i retrieval (50%)

Jeśli agent ma działać, musi pobierać właściwe dane, na czas, z jasnym kontekstem.

Co działa w praktyce:

- katalog danych + właścicielstwo (kto odpowiada za źródło),

- reguły jakości (co jest „poprawne” dla klienta/produktu/zamówienia),

- warstwa semantyczna / słownik pojęć (żeby „przychód” znaczył jedno),

- monitorowanie „freshness” i kompletności dla danych krytycznych.

2) Security (43%)

Agent to nowy typ użytkownika: szybki, zautomatyzowany i… czasem zbyt kreatywny.

Minimum:

- zasada najmniejszych uprawnień (least privilege),

- maskowanie/segmentacja PII,

- audyt (kto/co/po co pobrał),

- kontrola narzędzi: agent nie powinien mieć dostępu „do wszystkiego”.

3) Brak kompetencji agentic AI (42%)

Tu nie chodzi tylko o promptowanie. Chodzi o umiejętność projektowania:

- przepływu działań (workflow),

- momentów eskalacji do człowieka,

- testów i kryteriów akceptacji.

Szybki fix: playbook „jak działa agent u nas” + szkolenia z konkretnych przypadków użycia.

4) Słabe narzędzia do zarządzania agentami (39%)

Bez narzędzi robi się „shadow AI”, a potem gaszenie pożaru.

Warto mieć:

- rejestr agentów (kto jest właścicielem, jaki cel, jakie źródła danych),

- wersjonowanie i proces zmian,

- oceny (evals) po zmianie danych/modelu/narzędzi.

5) Observability (39%)

Jeśli nie wiesz, dlaczego agent zrobił X, to w produkcji masz problem.

Minimum obserwowalności:

- logi kroków (trace),

- metryki jakości odpowiedzi/akcji,

- alerty na odchylenia (np. nagły wzrost „niepewności”, błędów retrieval).

6) Guardrails (35%)

Guardrails to nie „hamulec”. To pasy bezpieczeństwa.

Najprostsze, a skuteczne:

- allowlista narzędzi i akcji,

- limity (rate limits, budżet tokenów/akcji),

- progi eskalacji (human-in-the-loop) dla działań nieodwracalnych.

Pilot → produkcja: dane wciąż są „wąskim gardłem”

W raporcie 57% liderów mówi wprost: data reliability nadal blokuje przejście z pilota do produkcji.

I to jest ciekawe: firmy wiedzą, co działa, bo wskazują konkretne kroki, które podejmują najczęściej:

- poprawa workflow wokół danych/AI (59%),

- inwestycje w data quality (54%) i metadane (54%),

- częstsze kontrole danych (53%),

- upskilling/hiring (47%),

- wsparcie zewnętrzne (43%).

To brzmi jak „duży program”, ale da się to ugryźć etapami.

Minimum viable AI governance (bez wielkiego programu na rok)

Raport pokazuje też, że 76% organizacji przyznaje: ich visibility i governance nie nadążają za tym, jak pracownicy używają AI.

Jeśli chcesz zacząć sensownie i szybko, potraktuj AI governance jako trzy proste pytania:

- Kto jest właścicielem agenta i danych, z których korzysta?

- Jakie ma uprawnienia i jak to audytujemy?

- Jak mierzymy jakość i ryzyko (i co robimy, gdy metryki spadają)?

To wystarczy, żeby przestać działać „na wiarę”.

Checklista „Agentic AI gotowe do produkcji” (do wykorzystania)

- Zdefiniowany cel agenta i granice odpowiedzialności

- Właściciel biznesowy + właściciel danych

- Lista źródeł danych + klasyfikacja (PII / wrażliwe)

- Reguły jakości dla danych krytycznych

- Monitoring jakości + freshness + alerty

- Warstwa semantyczna / słownik pojęć

- Kontrola dostępu (least privilege)

- Maskowanie/anonimizacja tam, gdzie trzeba

- Rejestrowanie działań agenta (trace)

- Metryki: skuteczność, błędy retrieval, eskalacje, czas, koszt

- Guardrails (allowlista narzędzi, limity, progi eskalacji)

- Testy regresji (po zmianie danych, modelu, promptów, narzędzi)

- Proces wersjonowania i wdrażania (kto zatwierdza zmiany)

- Szkolenie użytkowników: data literacy + AI literacy

- Plan „co robimy, gdy agent się myli” (runbook)

FAQ

Czy agentic AI to to samo co chatbot?

Nie. Chatbot głównie odpowiada. Agentic AI oprócz odpowiedzi wykonuje działania w procesie (np. tworzy zgłoszenie, aktualizuje rekord, inicjuje workflow).

Dlaczego agentic AI tak często wykłada się na danych?

Bo agent musi pobierać dane (retrieval) i na nich działać. W badaniu największą barierą produkcji jest właśnie data quality/retrieval (50%).

Od czego zacząć AI governance, żeby nie ugrzęznąć w dokumentach?

Od minimum: właścicielstwo, uprawnienia, audyt i metryki jakości/ryzyka. Dopiero potem rozbudowa frameworków.

Skąd te liczby (transparentnie)

To wnioski z raportu „CDO Insights 2026” przygotowanego przez Informatica na bazie badania Wakefield Research: 600 liderów danych (firmy $500M+ przychodu), USA/UK+EU/APAC, realizacja 12–25 września 2025.

CZYTAJ DALEJ NASZ BLOG